As diretrizes para proteger modelos de IA começam a emergir

À medida que a segurança dos modelos de inteligência artificial (IA) se tornará uma prioridade importante no próximo ano, o número de diretrizes disponíveis para ajudar a protegê-los está a aumentar rapidamente. O National Institute of Standards and Technology (NIST), por exemplo, publicou um Adversarial Machine Learning: A Taxonomy and Terminology of Attacks and Mitigations relatório que descreve as táticas e técnicas que os cibercriminosos provavelmente irão adaptar à medida que tentam comprometer os modelos de IA.

Ao mesmo tempo, a Cloud Security Alliance (CSA) lançou uma Iniciativa de Segurança de IA em parceria com a Amazon, Anthropic, Google, Microsoft e OpenAI para criar uma coligação de especialistas em segurança de IA da indústria, academia e agências governamentais, como a Cybersecurity & Infrastructure Security Agency (CISA).

Anteriormente, a CISA e o National Cyber Security Centre (NCSC) no Reino Unido anunciaram que também estão a colaborar em diretrizes para construir sistemas de IA seguros , que foram adotadas por 21 outras agências internacionais.

Cada um destes esforços permitirá à organização cumprir uma ordem executiva da administração Biden que estabeleceu requisitos para a segurança e proteção de IA, incluindo um requisito para que o NIST estabeleça padrões rigorosos para testes extensivos de red-team para garantir a segurança antes do lançamento público de qualquer modelo de IA fundamental que possa representar uma ameaça à segurança nacional. O Departamento de Segurança Interna também está encarregado de aplicar esses padrões aos setores de infraestruturas críticas e de estabelecer uma Junta de Segurança e Proteção de IA.

Coletivamente, estas iniciativas devem ajudar a abordar algumas falhas fundamentais na forma como os modelos de IA estão a ser desenvolvidos e implementados em ambientes de produção. Os modelos de IA são, no seu núcleo, outro tipo de artefacto de software que está sujeito aos mesmos problemas de vulnerabilidade que afetam outras aplicações. O malware que os cibercriminosos injetam em repositórios de software pode rapidamente encontrar o seu caminho para um modelo de IA. A questão é que, uma vez descoberto, o custo de reconstruir um modelo de IA é várias ordens de magnitude mais caro do que corrigir uma aplicação.

Além disso, os criminosos cibernéticos podem tentar fazer com que um modelo de IA delire deliberadamente, envenenando o conjunto de dados usado para treiná-lo. À medida que a saída de um modelo se torna menos confiável, uma organização vai reduzir a confiança que poderia ter num modelo treinado com um conjunto de dados impecável.

Os profissionais de cibersegurança têm uma oportunidade única de se inserirem no processo de desenvolvimento e implementação de modelos de Baseado em IA antes que estes acabem por estar profundamente integrados em quase todas as aplicações. Em vez de tentar resolver problemas após um incidente, o objetivo deve ser implementar os processos e práticas necessárias para evitar que incidentes de cibersegurança ocorram no futuro. Claro, não existe segurança perfeita, mas dado o carácter crítico das aplicações, uma abordagem proativa à segurança de IA já é imperativa.

O desafio, como sempre, é que os cientistas de dados e os desenvolvedores que constroem aplicações de IA nem sempre têm a maior apreciação pela segurança. Na verdade, os profissionais de cibersegurança precisarão procurar estes projetos simplesmente porque muitas das equipas que constroem modelos de IA, sem surpresa, vêem a cibersegurança como uma reflexão tardia. A boa notícia é que, com a ajuda de alguns frameworks bem definidos, as equipas de cibersegurança devem estar melhor preparadas para ajudar a proteger modelos de IA do que anteriormente conseguiram proteger tipos anteriores de novos tipos de artefatos de software à medida que surgiram inicialmente.

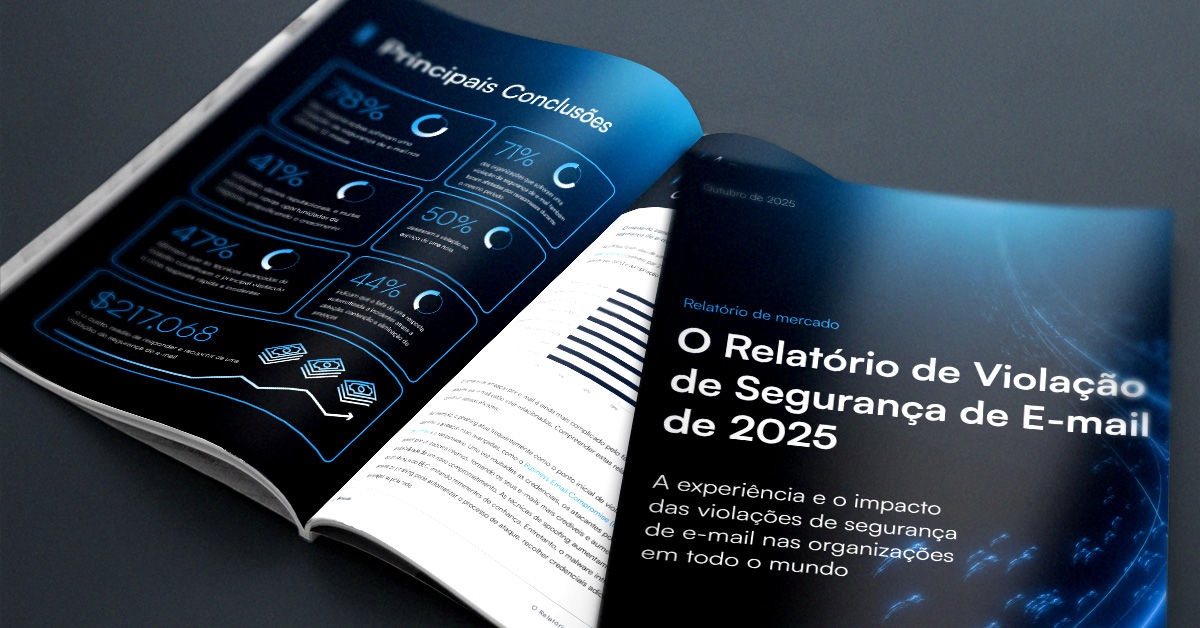

O Relatório de Invasão de Segurança de E-mail de 2025

Principais conclusões sobre a experiência e o impacto das violações de segurança de e-mail em organizações em todo o mundo

Subscreva o Blogue Barracuda.

Inscreva-se para receber destaques sobre ameaças, comentários do setor e muito mais.

Relatório de Insights do Cliente MSP 2025

Uma visão global sobre o que as organizações precisam e desejam dos seus provedores de serviços geridos de cibersegurança